17/02/2024

TensorFlow: Fra Grundlæggende til Avanceret

TensorFlow, udviklet af Google, har revolutioneret feltet for kunstig intelligens og maskinlæring. Som et open-source bibliotek til numerisk beregning og store-skala maskinlæring, tilbyder TensorFlow en fleksibel arkitektur, der kan køre på tværs af forskellige platforme, fra servere med CPU'er og GPU'er til mobile enheder og edge-enheder. Dens primære styrke ligger i dens evne til at håndtere komplekse beregninger gennem dataflow-grafer, hvor noder repræsenterer operationer, og kanter repræsenterer de data tensors, der flyder imellem dem. Dette gør det muligt at bygge, træne og implementere sofistikerede maskinlæringsmodeller effektivt.

Hvad er TensorFlow?

Kernen i TensorFlow er dens evne til at definere beregninger som en graf. Når du opretter en model i TensorFlow, definerer du et netværk af operationer. Disse operationer udføres på tensors, som er flerdimensionelle arrays af data. TensorFlow bygger en graf, der beskriver, hvordan data flyder gennem disse operationer. Denne graf kan derefter kompileres og optimeres til at køre på forskellige hardware-accelerationer, såsom GPU'er (Graphics Processing Units) eller TPU'er (Tensor Processing Units), hvilket dramatisk kan accelerere træningsprocessen.

TF-AMP: Automatisk Mixed Precision

TF-AMP, eller TensorFlow Automatic Mixed Precision, er en funktion i TensorFlow, der automatisk styrer brugen af både 32-bit floating-point (FP32) og 16-bit floating-point (FP16) præcision under træning af neurale netværk. Formålet med TF-AMP er at opnå en betydelig hastighedsforøgelse og reducere hukommelsesforbruget uden at ofre nøjagtigheden af modellen. Dette opnås ved at udføre visse operationer i FP16, som kræver mindre hukommelse og kan behandles hurtigere af moderne hardware, mens følsomme operationer opretholdes i FP32 for at bevare nøjagtigheden.

Hvordan virker TF-AMP?

TF-AMP fungerer ved at identificere operationer i modellen, der sikkert kan udføres i FP16. Typisk er dette de operationer, der ikke er følsomme over for tab af præcision. For at forhindre potentielle problemer med underflow (tal, der bliver for små til at blive repræsenteret korrekt i FP16), anvendes en teknik kaldet 'loss scaling'. Dette indebærer at multiplicere tabsfuntionen med en stor faktor, hvilket øger værdien af gradienterne. Efterfølgende skaleres gradienterne tilbage til deres oprindelige størrelse, før de anvendes til at opdatere modelparametrene. TF-AMP håndterer disse trin automatisk, hvilket gør det nemt for udviklere at drage fordel af mixed precision.

| Fordel | Beskrivelse |

|---|---|

| Hastighedsforøgelse | Operationer i FP16 kan være op til 2x hurtigere på understøttet hardware. |

| Reduceret Hukommelsesforbrug | FP16-tensorer fylder halvdelen af FP32-tensorer, hvilket muliggør træning af større modeller eller brug af større batch-størrelser. |

| Bevaring af Nøjagtighed | Ved at bruge 'loss scaling' og strategisk FP32, minimeres tab af nøjagtighed. |

RunInference: Udførelse af Modeller

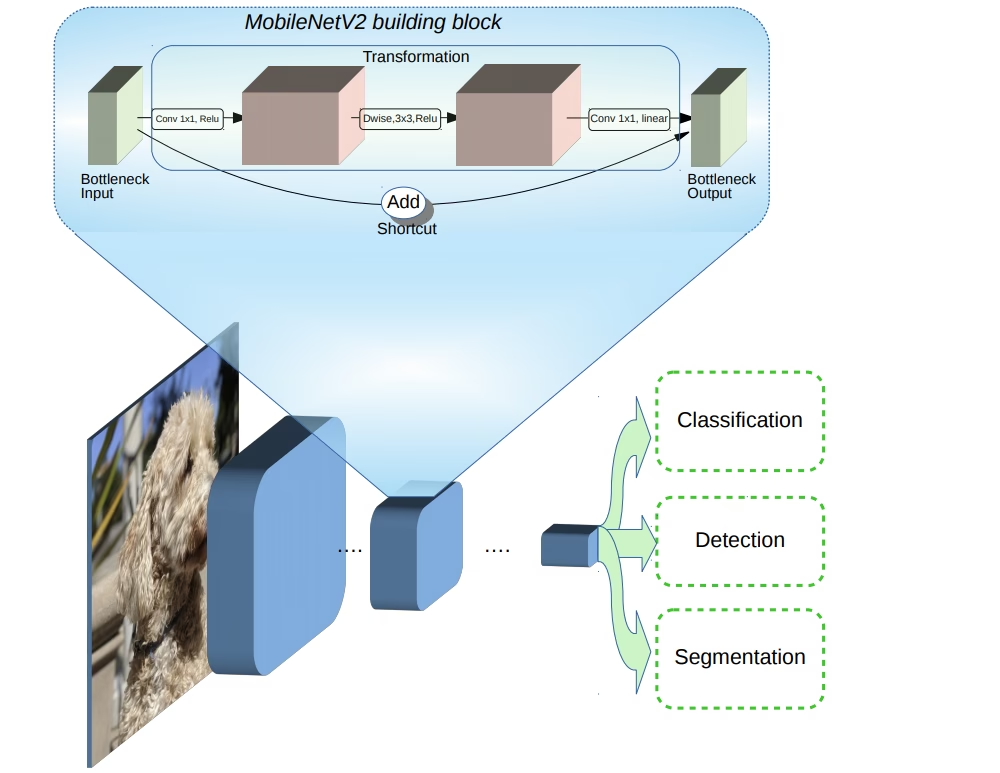

Når en model er trænet, er næste skridt at implementere den for at lave forudsigelser på nye data. Dette kaldes inferens. Funktionen `runInference` er en generisk betegnelse for processen med at føre inputdata gennem en trænet model for at opnå et output. Inputtet til denne funktion er typisk en eller flere input-tensorer, som repræsenterer de data, modellen skal behandle (f.eks. et billede, en tekststreng eller numeriske data).

Hvordan fungerer runInference(input_tensor)?

Når du kalder `runInference` med en `input_tensor`, sker der følgende:

- Dataforberedelse: Input-dataene skal formateres korrekt, så de matcher modellens forventede input-shape og datatypen. Dette kan involvere normalisering, ændring af dimensioner eller konvertering til den korrekte tensor-type.

- Model-kørsel: Den forberedte `input_tensor` sendes gennem den trænede TensorFlow-model. TensorFlow udfører de operationer, der er defineret i modellen, ved at beregne værdierne af de efterfølgende tensorer i dataflow-grafen.

- Output-generering: Modellen producerer en eller flere output-tensorer som resultat. Disse output kan repræsentere en klassificering, en forudsigelse, en segmenteringsmaske eller andre former for resultater, afhængigt af modellens formål.

- Post-processing: Output-tensorerne kan kræve yderligere behandling for at blive konverteret til et brugervenligt format. Dette kan omfatte at finde den mest sandsynlige klasse, konvertere sandsynligheder til kategorier eller visualisere resultaterne.

For at optimere inferens kan man benytte sig af teknikker som modelkvantisering, grafoptimering og brug af hardware-accelerationer. TensorFlow Lite er specifikt designet til effektiv inferens på mobile og embedded enheder.

Praktisk Anvendelse af TensorFlow

TensorFlow bruges i en bred vifte af applikationer:

- Billedgenkendelse: Klassificering af billeder, objektgenkendelse, ansigtsgenkendelse.

- Naturlig Sprogbehandling (NLP): Maskinoversættelse, sentimentanalyse, chatbots.

- Anbefalingssystemer: Personaliserede produkt- eller indholdsanbefalinger.

- Tidsrækkeanalyse: Forudsigelse af aktiekurser, vejrprognoser.

- Robotik og Autonome Systemer: Styring af robotter, selvkørende biler.

Opsætning af TensorFlow

At komme i gang med TensorFlow kræver typisk installation af Python og derefter installation af TensorFlow-biblioteket via pip:

pip install tensorflow For at udnytte GPU-acceleration skal du også installere NVIDIA CUDA Toolkit og cuDNN, og derefter installere TensorFlow med GPU-support:

pip install tensorflow[and-cuda] Det er vigtigt at sikre, at din hardware og softwareversioner er kompatible for at undgå installationsproblemer. Tjek altid den officielle TensorFlow-dokumentation for de seneste installationsvejledninger.

Fremtiden for TensorFlow

TensorFlow fortsætter med at udvikle sig, med fokus på at gøre maskinlæring mere tilgængelig og effektiv. Nøgleområder for fremtidig udvikling inkluderer forbedret understøttelse af edge computing, mere avancerede værktøjer til modeludvikling og -implementering, samt integration med andre Google Cloud AI-tjenester. TensorFlow's fleksibilitet og kraft gør det til et uundværligt værktøj for enhver, der arbejder med AI og maskinlæring.

Ofte Stillede Spørgsmål (FAQ)

Hvad er forskellen mellem TensorFlow og Keras?

Keras er et high-level API, der kan køre oven på TensorFlow (eller andre backends). TensorFlow er selve deep learning-frameworket. Keras gør det nemmere og hurtigere at bygge og træne modeller, mens TensorFlow giver mere kontrol over de underliggende operationer.

Kan jeg bruge TF-AMP på CPU'er?

TF-AMP er primært designet til at drage fordel af hardware, der understøtter FP16-beregninger, såsom moderne GPU'er. Selvom det kan være teknisk muligt at køre dele af beregningerne i lavere præcision på CPU'er, er fordelene typisk minimale sammenlignet med GPU-acceleration.

Hvad er en tensor i TensorFlow?

En tensor er den grundlæggende datastruktur i TensorFlow. Det er et flerdimensionelt array af værdier. En tensor kan være en skalar (0D tensor), en vektor (1D tensor), en matrix (2D tensor) eller have højere dimensioner.

Hvordan vælger jeg den rigtige batch-størrelse til træning?

Valget af batch-størrelse påvirker både træningshastigheden og modellens generaliseringsevne. Mindre batch-størrelser kan føre til mere støjende gradienter, hvilket kan hjælpe med at undslippe lokale minima, men træningen kan tage længere tid. Større batch-størrelser kan føre til hurtigere konvergens, men kan kræve mere hukommelse og potentielt føre til dårligere generalisering. Det kræver ofte eksperimentering at finde den optimale batch-størrelse.

TensorFlow tilbyder et rigeligt økosystem af værktøjer og ressourcer, der understøtter hele livscyklussen for maskinlæring, fra databehandling og modeltræning til implementering og overvågning. Ved at forstå de grundlæggende koncepter som dataflow-grafer, tensorer, og specifikke funktioner som TF-AMP og inferensprocessen, kan udviklere udnytte kraften i TensorFlow til at skabe innovative AI-løsninger.

Hvis du vil læse andre artikler, der ligner TensorFlow: Fra Grundlæggende til Avanceret, kan du besøge kategorien Teknologi.