26/05/2025

I den moderne verden af mobilapplikationsudvikling er video en uundværlig del af mange brugeroplevelser. Fra videoredigering og streaming til augmented reality og kommunikation, kræver håndtering af videoindhold høj ydeevne og effektivitet. Når det kommer til H.264-video på iOS-platformen, en af de mest udbredte videokodecs, er valget af den rigtige tilgang afgørende. At opnå optimal hastighed og minimalt strømforbrug for både kodning (encoding) og afkodning (decoding) af H.264-video kræver en specifik strategi, og her er der kun én sand vej: Apples egen AVFoundation-ramme.

Mange udviklere falder i fælden med at overveje tredjepartsbiblioteker til videohåndtering, lokket af løfter om enkelhed eller bredere formatunderstøttelse. Men når det gælder H.264 på iOS, er dette en fejl, der kan koste dyrt i både ydeevne og batterilevetid. Årsagen er simpel: iOS-enheder er udstyret med specialiseret hardware til accelereret videoafkodning og -kodning. Disse hardware-acceleratorer er designet til at udføre komplekse videoprocesseringsopgaver med en hastighed og effektivitet, som CPU-baserede softwareløsninger simpelthen ikke kan matche. AVFoundation er Apples grænseflade til denne kraftfulde hardware, hvilket gør det til det eneste levedygtige valg for H.264-video på iOS.

- Hvorfor Hardware-Acceleration er Afgørende for H.264 på iOS

- AVFoundation til Afkodning af H.264-video: AVAssetReader

- AVFoundation til Kodning af H.264-video: AVAssetWriter

- GPUImage Framework: Et Åbent Kildekode Eksempel

- Ofte Stillede Spørgsmål om H.264 og AVFoundation på iOS

- Hvorfor kan jeg ikke bare bruge et populært tredjepartsbibliotek som FFmpeg?

- Hvad er en CVPixelBufferPool, og hvorfor er den vigtig?

- Hvad er BGRA, og hvorfor er det bedre end RGBA for kodning?

- Kan jeg bruge AVFoundation til andre videoformater end H.264?

- Er AVFoundation svært at lære og implementere?

- Konklusion

Hvorfor Hardware-Acceleration er Afgørende for H.264 på iOS

Forståelsen af hardware-acceleration er grundlæggende for at værdsætte AVFoundation. Traditionel videokodning og -afkodning er yderst beregningsintensiv. Hvis disse opgaver udføres udelukkende af enhedens hovedprocessor (CPU), vil det føre til flere problemer:

- Langsommere Ydeevne: CPU'en er en general-purpose processor, der skal håndtere alle applikationens opgaver. Videoprocessering vil optage en stor del af dens ressourcer, hvilket fører til hakkende video, langsomme eksporter og en generelt dårlig brugeroplevelse.

- Højere Strømforbrug: En CPU, der arbejder på fuld kapacitet, bruger betydeligt mere strøm end dedikeret hardware. Dette dræner hurtigt enhedens batteri, hvilket er en kritisk faktor for mobile apps.

- Overophedning: Høj CPU-belastning kan også føre til, at enheden overophedes, hvilket kan reducere dens levetid og tvinge systemet til at drosle ned på ydeevnen.

Apples iOS-enheder, fra iPhones til iPads, indeholder specialiserede chips – ofte en del af System on a Chip (SoC) – der er optimeret specifikt til videokodning og -afkodning. Disse chips kan udføre opgaver som bevægelsesestimering, transformering og kvantisering (nøglekomponenter i H.264) med en hastighed og energieffektivitet, som er umulig at opnå i software. AVFoundation giver udviklere adgang til denne hardware, hvilket sikrer, at din app kører så hurtigt og effektivt som muligt.

Faldgruben ved Tredjepartsbiblioteker

Mange tredjepartsbiblioteker til videohåndtering er bygget til at være platformsuafhængige og anvender ofte CPU-baserede implementeringer af videokodecs. Selvom dette kan være praktisk for tværplatformsudvikling, er det et stort kompromis på iOS, når det gælder H.264. Disse biblioteker vil sandsynligvis være markant langsommere og mere strømkrævende end AVFoundation, da de ikke kan udnytte den indbyggede hardware-acceleration. Den eneste legitime grund til at overveje et tredjepartsbibliotek er, hvis du skal arbejde med et videoformat, der absolut ikke understøttes indbygget af iOS – men for H.264 er dette aldrig tilfældet.

AVFoundation til Afkodning af H.264-video: AVAssetReader

Når det kommer til hardware-accelereret afkodning af H.264-video på iOS, er AVAssetReader dit primære værktøj. AVAssetReader er en klasse inden for AVFoundation, der giver dig mulighed for at læse medier fra en AVAsset (som repræsenterer en video- eller lydfil) på en effektiv måde. Det er designet til at give dig rå adgang til de afkodede videorammer, hvilket er ideelt for applikationer, der skal analysere, behandle eller manipulere videodata ud over blot afspilning.

Med AVAssetReader kan du opnå imponerende afspilningshastigheder. Det er ikke ualmindeligt at se 2x eller endda højere afspilningshastigheder, når man læser H.264-kodet video, hvilket vidner om den fremragende hardware-acceleration, som iOS-enheder tilbyder. Dette er essentielt for opgaver som hurtig forhåndsvisning, videoanalyse eller frame-by-frame redigering, hvor hurtig og pålidelig adgang til individuelle videorammer er nødvendig.

For ren afspilning kan du også bruge AVPlayer-klasserne, som er optimeret til netop dette formål og automatisk udnytter hardware-accelerationen. Men hvis du har brug for at trække de rå videorammer ud til yderligere bearbejdning, er AVAssetReader vejen frem.

AVFoundation til Kodning af H.264-video: AVAssetWriter

Ligesom AVAssetReader er nøglen til hurtig afkodning, er AVAssetWriter det tilsvarende værktøj for hardware-accelereret kodning af H.264-video. AVAssetWriter giver dig mulighed for at skrive mediedata til en ny fil, typisk i et format som MP4, ved at udnytte enhedens hardware-kodere. At få AVAssetWriter til at kode med den bedst mulige hastighed kræver dog, at man kender til og anvender nogle specifikke 'tricks' eller best practices. Disse metoder sikrer, at du maksimerer udnyttelsen af den underliggende hardware og undgår unødvendige kopieringer eller formatkonverteringer, som kan bremse processen.

Optimering af AVAssetWriter Performance

For at opnå den højeste kodningshastighed med AVAssetWriter skal du være opmærksom på følgende punkter:

- Fodring med BGRA-rammer: Den mest effektive måde at tilføre videorammer til AVAssetWriter på er i BGRA (Blue, Green, Red, Alpha) pixelformat. Mange standard billedformater er i RGBA, men hardware-kodere på iOS er ofte optimeret til BGRA. Ved at levere rammer i dette format undgår du en intern konvertering, som ville forbruge CPU-cyklusser og forlænge kodningsprocessen. Sørg for, at dine input-videorammer allerede er i BGRA-format, eller at du udfører konverteringen på en effektiv måde (f.eks. med GPU-acceleration).

- Brug af Pixel Buffer Pool (CVPixelBufferPool): Når du gentagne gange behandler videorammer, er det yderst ineffektivt at allokere og deallokere CVPixelBuffer-objekter for hver ramme. En CVPixelBufferPool genbruger hukommelsesbuffere, hvilket reducerer hukommelsesfragmentering og overhead. Ved at allokere buffere fra en pulje kan du drastisk forbedre ydeevnen og reducere CPU-belastningen, da systemet ikke konstant skal anmode om ny hukommelse. Dette er især vigtigt for realtids- eller højvolumen videobehandling.

- Brug af iOS 5.0 Texture Caches (CVOpenGLESTextureCache) ved læsning fra OpenGL ES: Hvis dine videorammer kommer fra en OpenGL ES-rendering pipeline (f.eks. fra et kamera-feed, der er blevet behandlet med OpenGL ES-filtre), bør du udnytte CVOpenGLESTextureCache (introduceret i iOS 5.0). Denne cache giver en meget effektiv måde at dele teksturdata mellem OpenGL ES og CoreVideo (som AVFoundation bygger på). I stedet for at læse teksturdata tilbage til CPU-hukommelsen og derefter overføre dem til AVAssetWriter, kan tekstur-caches give direkte adgang til GPU-allokeret hukommelse, hvilket eliminerer unødvendige dataoverførsler og kopieringer. Dette resulterer i en markant hurtigere og mere strømeffektiv videoprocessering.

Sammenligning: AVFoundation vs. CPU-begrænset Tredjepartsbibliotek

For at illustrere fordelene ved AVFoundation, lad os se på en generel sammenligning:

| Egenskab | Hardware-Accelereret (AVFoundation) | CPU-begrænset (Tredjepart) |

|---|---|---|

| Hastighed (Kodning/Afkodning) | Meget høj (udnytter dedikeret hardware) | Langsom (begrænset af CPU'ens generelle kapacitet) |

| Strømforbrug | Lavt (energieffektiv hardware) | Højt (CPU-intensive beregninger) |

| Batterilevetid | Optimeret, længere | Reduceret, kortere |

| Enhedens Temperatur | Lav | Højere, risiko for overophedning |

| Systembelastning | Lav | Høj, kan påvirke andre app-processer |

| Kompleksitet (H.264) | Medium (kræver forståelse af AVFoundation API) | Ofte lavere API-kompleksitet, men højere ydeevne-kompleksitet |

| Understøttede Formater | Standard iOS-formater (H.264, HEVC, etc.) | Kan understøtte nicheformater uden for iOS's standard |

Denne tabel understreger klart, hvorfor AVFoundation er det foretrukne valg for H.264 på iOS. Den ydeevne og effektivitet, du får med hardware-acceleration, kan simpelthen ikke matches af CPU-baserede løsninger.

GPUImage Framework: Et Åbent Kildekode Eksempel

Hvis du ønsker at se kode, der anvender de hurtigste veje for accelereret kodning og afkodning, kan du kigge på det open source GPUImage framework. Dette framework er helt gratis at bruge og demonstrerer, hvordan man effektivt kan udnytte AVFoundation og OpenGL ES (eller Metal i nyere versioner) til at behandle video i realtid. Det er et fremragende eksempel på, hvordan de nævnte 'tricks' implementeres i praksis for at opnå maksimal ydeevne.

GPUImage viser, hvordan man kan binde CVPixelBufferPools og CVOpenGLESTextureCaches sammen med AVAssetWriter for at skabe en yderst effektiv videobehandlingspipeline. Ved at studere kildekoden kan du få en dybere forståelse af de lavniveau-optimeringer, der er nødvendige for at udnytte iOS-hardwarens fulde potentiale.

Ofte Stillede Spørgsmål om H.264 og AVFoundation på iOS

Hvorfor kan jeg ikke bare bruge et populært tredjepartsbibliotek som FFmpeg?

FFmpeg er et utroligt kraftfuldt og alsidigt bibliotek, men dets standardimplementeringer er CPU-baserede. Selvom det kan kompileres til iOS, vil det ikke udnytte enhedens dedikerede hardware-acceleratorer til H.264. Dette betyder, at det vil være markant langsommere, mere strømkrævende og kan føre til overophedning af enheden sammenlignet med AVFoundation. Brug kun FFmpeg eller lignende biblioteker, hvis du absolut skal arbejde med et videoformat, som AVFoundation ikke understøtter, eller hvis du har meget specifikke, lavniveau-krav, der ikke kan opfyldes af AVFoundation.

Hvad er en CVPixelBufferPool, og hvorfor er den vigtig?

En CVPixelBufferPool er en samling af genbrugelige CVPixelBuffer-objekter. Når du arbejder med videorammer, især i en pipeline, hvor rammer oprettes og frigives kontinuerligt, kan konstant allokering og deallokering af hukommelse være en stor flaskehals. En pixelbufferpulje forsyner dig med allerede allokerede buffere, når du har brug for dem, og genbruger dem, når du er færdig. Dette minimerer hukommelsesoverhead, reducerer CPU-belastning og forbedrer den samlede ydeevne og stabilitet af din videoapplikation.

Hvad er BGRA, og hvorfor er det bedre end RGBA for kodning?

BGRA og RGBA refererer til rækkefølgen af farvekomponenter (Blå, Grøn, Rød, Alfa) inden for hver pixel. Selvom RGBA er et almindeligt format, er mange hardware-acceleratorer på iOS (og andre platforme) internt optimeret til BGRA. Ved at levere dine pixeldata i BGRA-format undgår du, at systemet skal udføre en intern farvekomponent-ombytning, hvilket sparer CPU-cyklusser og fremskynder kodningsprocessen. Det er en lille detalje, men den kan have en mærkbar indflydelse på ydeevnen ved højvolumen videobehandling.

Kan jeg bruge AVFoundation til andre videoformater end H.264?

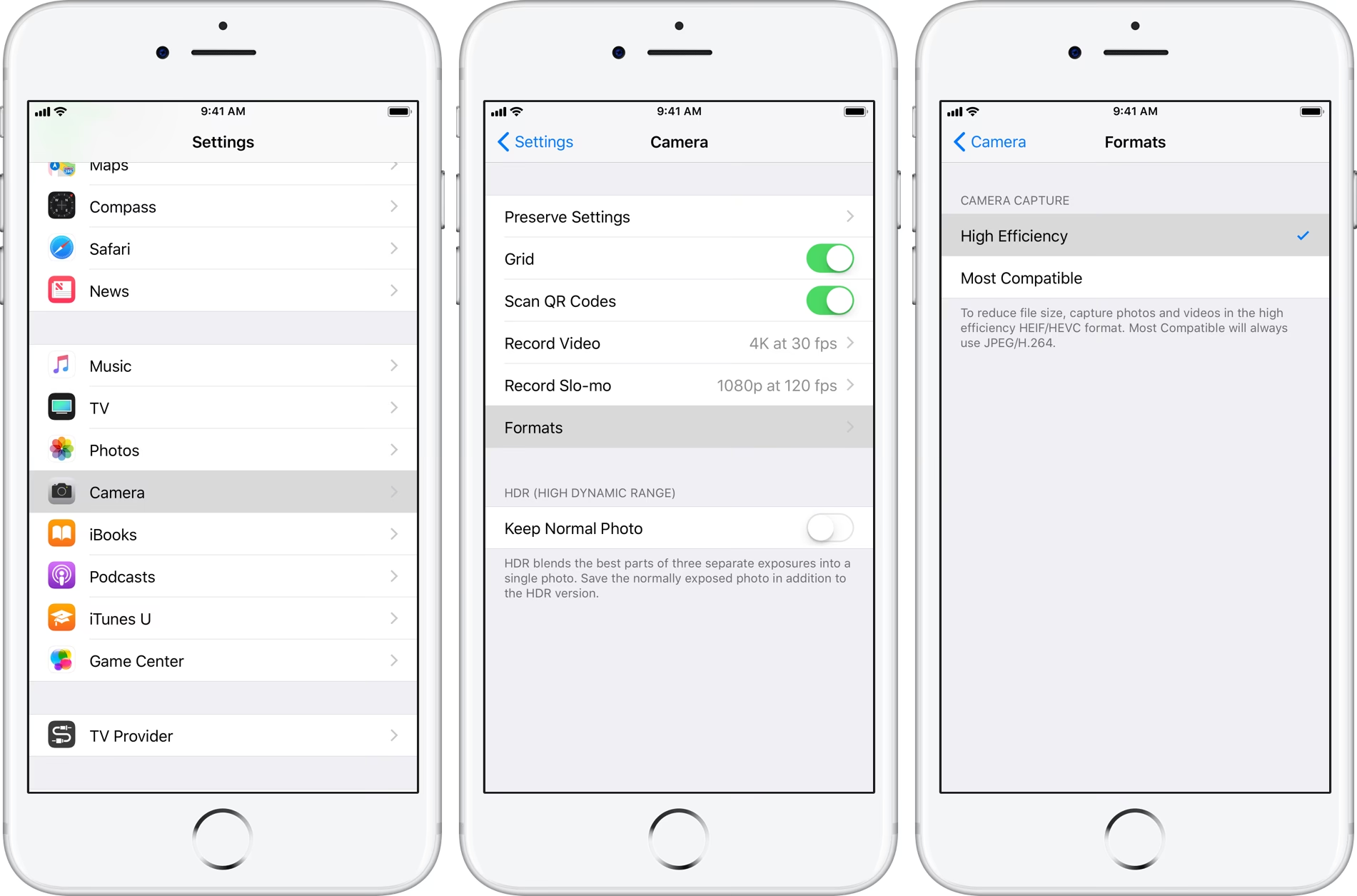

Ja, AVFoundation understøtter en række andre video- og lydformater, herunder HEVC (H.265), der er et nyere og mere effektivt videoformat, samt ProRes og forskellige lydformater. Apple fortsætter med at udvide AVFoundations muligheder med nye iOS-versioner, hvilket gør det til et alsidigt framework for næsten alle dine mediebehov på platformen.

Er AVFoundation svært at lære og implementere?

AVFoundation er et omfattende framework med mange klasser og koncepter, hvilket kan virke overvældende i starten. Men for grundlæggende H.264-kodning og -afkodning er de nødvendige API'er relativt ligetil. Apples dokumentation er god, og der findes mange online-ressourcer og eksempler (som GPUImage), der kan hjælpe dig i gang. At investere tid i at lære AVFoundation vil betale sig mange gange i form af ydeevne og pålidelighed i dine videoapplikationer.

Konklusion

For udviklere, der ønsker at håndtere H.264-video på iOS, er der ingen vej udenom AVFoundation. Det er det eneste framework, der giver adgang til enhedens kraftfulde hardware-acceleratorer, hvilket sikrer uovertruffen hastighed, lavt strømforbrug og en generelt overlegen brugeroplevelse. Ved at mestre brugen af AVAssetReader til afkodning og AVAssetWriter til kodning – og især ved at anvende optimeringerne som BGRA-rammer, pixelbufferpuljer og tekstur-caches – kan du skabe videoapplikationer, der yder optimalt på Apples mobile enheder. Undgå fristelsen til at bruge CPU-tunge tredjepartsbiblioteker til H.264; AVFoundation er din bedste allierede i den digitale videoverden på iOS.

Hvis du vil læse andre artikler, der ligner H.264-video på iOS: AVFoundation er Nøglen, kan du besøge kategorien Teknologi.